В последние годы использование искусственного интеллекта в разработке программного обеспечения стало стандартом, однако это приводит к возникновению "долга понимания" — скрытой цене, которую платят инженеры, полагаясь на автоматизированные инструменты. Этот термин описывает последствия чрезмерной зависимости от ИИ, когда команда теряет ясность в своем коде, что может привести к серьезным проблемам в будущем.

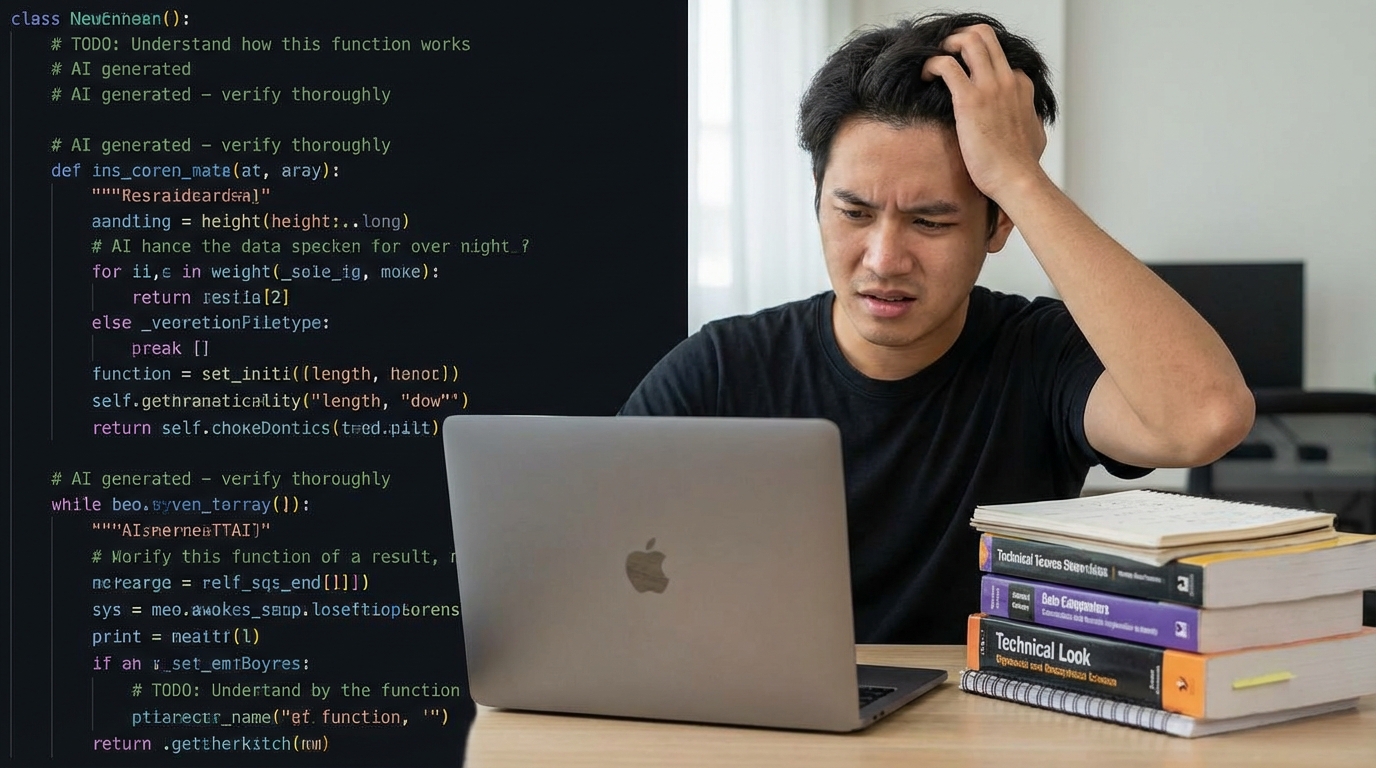

Команды разработчиков, активно использующие инструменты для генерации кода, могут столкнуться с накоплением издержек, которые не сразу заметны. Процесс проверки автоматически сгенерированного кода, ставший утомительным, ведет к тому, что ни один член команды не может объяснить, как различные части системы взаимодействуют друг с другом. Это происходит на фоне внешней уверенности в чистоте и корректности кода, что, в конечном итоге, может обернуться неожиданными сложностями.

Недавнее исследование компании Anthropic выявило, что программисты, использующие ИИ для генерации кода, продемонстрировали на 17% худшие результаты в тестах на понимание по сравнению с коллегами, работавшими без такой помощи. Особенно заметным было снижение при отладке кода, что подчеркивает важность активного участия разработчиков в процессе, а не просто делегирования задач ИИ.

Одной из ключевых проблем является асимметрия скорости: ИИ генерирует код быстрее, чем разработчики могут его обработать. Это создает иллюзию, что производительность процесса разработки улучшилась, однако на самом деле это только ухудшает понимание кода. В результате возникает ситуация, когда менее опытные инженеры могут создавать код быстрее, чем более опытные могут его критически оценить.

Автоматизация тестирования и верификации кода также не решает проблему. Тесты не могут предсказать все возможные ошибки, особенно те, которые не были предусмотрены изначально. Поэтому, как показывает практика, недостаточно просто полагаться на тесты — необходимо глубокое понимание кода и его структуры.

Решение проблемы "долга понимания" не заключается в создании подробных спецификаций, так как они не смогут учесть все нюансы, возникающие при переводе намерений в код. Два разработчика, следуя одной и той же спецификации, могут создать совершенно разные реализации, и каждая из них может оказать влияние на пользователей.

Таким образом, "долг понимания" ставит под сомнение устойчивость и безопасность разработок, основанных на ИИ. Это означает, что компании должны переосмыслить свои подходы к внедрению ИИ в разработку, чтобы избежать потенциальных рисков и сохранить качество конечного продукта на высоком уровне.

Meta* (Instagram*, Facebook*) и другие признанные экстремистскими организации/ресурсы запрещены в РФ.

Упоминания иностранных агентов сопровождаются маркировкой по закону.

Информационный материал. 18+.